Pesquisa revela que o banco de dados desprotegido de uma plataforma de geração de imagens de IA estava acessível abertamente na internet, expondo fotos de pessoas reais que foram submetidas ao processo de ‘nudificação’ por inteligência artificial

Um grave incidente de segurança expôs a fragilidade ética e técnica do mercado de Inteligência Artificial generativa. Uma startup de criação de imagens por IA deixou um banco de dados contendo mais de 1 milhão de imagens e vídeos abertamente acessível na internet, segundo uma nova pesquisa revisada pela WIRED. A grande maioria dos arquivos continha nudez e conteúdo explícito, incluindo possíveis representações de crianças ou deepfakes envolvendo rostos de crianças.

- Participe dos nossos canais no Twitter, Telegram ou Whatsapp!

- Confira nossos stories no Instagram e veja notícias como essa!

- Siga o tecflow no Spotify Podcast para ouvir nosso conteúdo!

- Anuncie conosco aqui ou apoie o tecflow clicando neste link

- Assine nossa newsletter neste link

- Siga o tecflow no tik tok

O pesquisador de segurança Jeremiah Fowler, que descobriu a falha em outubro, relatou que plataformas como MagicEdit e DreamPal (operadas pela startup DreamX ou entidades relacionadas) pareciam utilizar o mesmo banco de dados sem proteção. Na época da descoberta, cerca de 10 mil novas imagens eram adicionadas diariamente.

O problema da “Nudificação” não consensual

O vazamento expôs não apenas conteúdo gerado por IA, mas também fotos “inalteradas” de pessoas reais que foram, presumivelmente, enviadas para serem “nudificadas” ou terem seus rostos trocados em corpos nus gerados por IA.

Fowler, que já descobriu três bancos de dados mal configurados de geração de imagens de IA neste ano, alerta para o risco central: “A verdadeira questão são apenas pessoas inocentes, e especialmente menores de idade, tendo suas imagens usadas sem o seu consentimento para criar conteúdo sexual,” afirmou Fowler, que publicou suas descobertas no blog da ExpressVPN.

A descoberta ocorre em um momento crítico, onde o ecossistema de serviços de “nudificação” por IA – usados por milhões de pessoas – tem sido amplamente explorado para criar imagens explícitas maliciosas, em grande parte de mulheres, a partir de fotos roubadas de redes sociais. Relatos de criminosos usando IA para criar material de abuso sexual infantil dobraram no último ano.

Resposta da empresa e desaparecimento dos aplicativos

A DreamX, startup que opera MagicEdit e DreamPal, afirmou que leva as preocupações “extremamente a sério” e negou envolvimento direto de uma empresa de marketing ligada aos fundadores, a SocialBook, na operação do banco de dados. No entanto, o relatório de Fowler indicou que o banco de dados continha imagens com a marca d’água da SocialBook, e várias páginas do site da empresa que mencionavam MagicEdit ou DreamPal passaram a retornar erros.

Após o contato de Fowler, a DreamX declarou ter encerrado o acesso ao banco de dados exposto e lançado uma “investigação interna com assessoria jurídica externa”. A empresa também suspendeu o acesso aos seus produtos e removeu os aplicativos (como MagicEdit e DreamPal) da App Store da Apple. O Google, por sua vez, confirmou que havia suspendido anteriormente aplicativos da desenvolvedora ligada à startup devido a violações de políticas relacionadas a “conteúdo explicitamente sexual” ou nudez.

ONS faz corte emergencial inédito no fim de semana; Entenda

O Operador Nacional do Sistema Elétrico (ONS) precisou acionar um plano de contingência que nunca havia sido usado antes na…

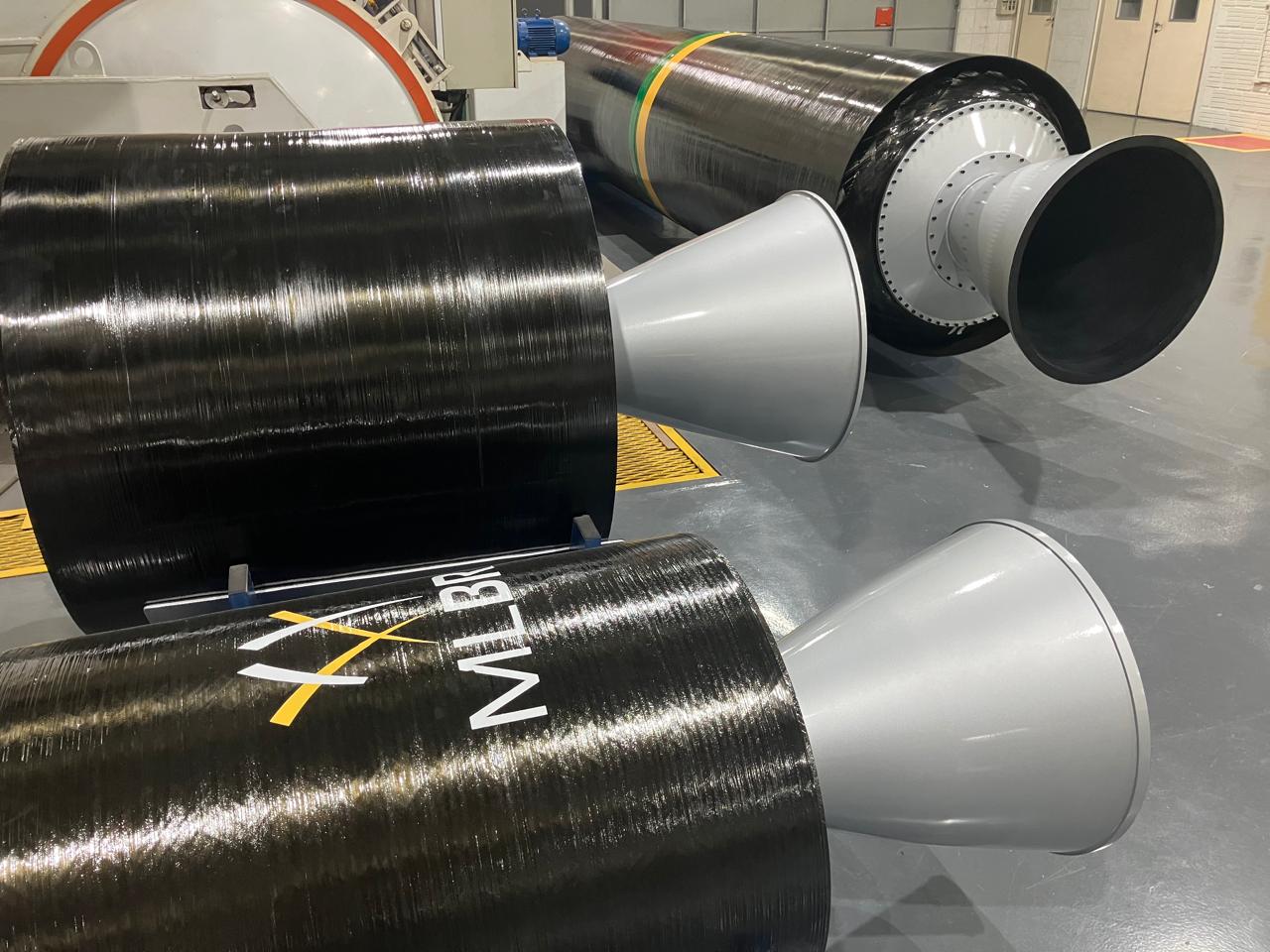

Foguete nacional MLBR avança com testes de motores para lançamento

O Brasil está prestes a dar um salto histórico e chocar o mundo com sua tecnologia aeroespacial! Se você achava…

SNP e Structify consolidam capacidades de IA para transformar Dados

A iniciativa é conduzida por meio da Oros Data LLC, uma joint venture criada entre SNP e Structify para ajudar…

Assista agora! Jogos no PS5, Gears E-Day em outubro e

O momento mais aguardado e tenso para os fãs do Xbox na Summer Game Fest finalmente está aqui. Neste domingo,…

Com usinas acionadas em agosto, leilão de energia trará reajuste

O governo já bateu o martelo. Uma nova taxa bilionária vai pesar no seu bolso ano após ano, e o…

Samsung Ocean oferece cursos gratuitos de IA, programação, Digital Health,

Programa de capacitação tecnológica da Samsung oferece aulas, workshops e laboratórios gratuitos em formato online e presencial, com certificado de…

A falha ética e a apatia com a segurança

O pesquisador afirma que o banco de dados continha 1.099.985 registros, sendo “quase todos” de natureza pornográfica. Embora a DreamX afirme que implementava mecanismos de moderação, como a filtragem de prompts através da API de Moderação do OpenAI, a exposição massiva sugere uma falha grave na infraestrutura.

O caso é visto por especialistas como um exemplo de “apatia que as startups sentem em relação à confiança e segurança”, especialmente na proteção de menores.

“Eles fizeram um ótimo trabalho de promoção sutil de conteúdo sexualizado,” disse Fowler, alertando que ferramentas de nudez podem facilmente ser “transformadas em armas” para extorsão e assédio. “Essas empresas realmente têm que fazer mais do que apenas um pop-up genérico: ‘Ao clicar aqui, você concorda que tem consentimento para fazer upload desta foto.’ Você não pode deixar as pessoas se policiaram sozinhas, porque elas não o farão.”

com informações da WIRED.

Faça como os mais de 10.000 leitores do tecflow, clique no sino azul e tenha nossas notícias em primeira mão! Confira as melhores ofertas de celulares naloja parceira do tecflow.

Marciel

Formado em Jornalismo, o editor atua há mais de 10 anos na cobertura de notícias relacionadas ao mercado B2B. Apesar de toda a Transformação Digital, ainda prefere ouvir música de forma analógica, no toca-discos.